要提升HelloWorld客服翻译的响应速度,首先得从“把翻译看成一条流水线”出发,拆解出网络、模型推理、缓存与前端渲染、人工校对四个主要环节,针对性地并行化与降本增速:优先做智能分流与边译边显、使用小模型+蒸馏加速初译、实现短语缓存与本地化术语库、提升并发网络链路与CDN分发,并结合SLA分级和自动化回退策略;同时落地监控、AB测试与持续模型微调,训练客服快速校对流程,这样可以在保证准确度的前提下将平均响应时间显著缩短并稳定在可控范围内。。

先把问题说清楚:为什么要优化响应速度

想象一下你在海外购物,等待客服翻译回复就像等电梯——等得久了心就慌了。短时间内拿到准确翻译,不只是体验更好,还直接影响转化、投诉率和客服成本。对企业而言,响应越快,单位时间能处理的会话越多,人工成本下降;对用户而言,延迟越低,满意度越高,纠纷和重复沟通减少。

三个直观的影响

- 用户体验:即时或接近实时的翻译让对话连贯,降低流失。

- 运营效率:缩短每个会话的平均处理时间(AHT),同样的人力支持更多客户。

- 成本与风险:更少的重复沟通与误解,降低退货、投诉与法律风险。

把系统拆成可解决的小问题(费曼法)

讲清楚再动手:把“客服翻译响应慢”拆成几个部分——网络延迟、模型推理时间、IO/序列化、前端渲染、人工校验等待。每一部分都有独立的优化空间,先从最影响总体延迟的部分下手。

常见瓶颈一览表

| 环节 | 典型延迟 | 可行优化 |

| 网络(客户端↔服务器) | 50–300ms | CDN、长连接、并发复用、压缩 |

| 模型推理 | 50–2000ms(视模型) | 蒸馏、小模型、量化、GPU/TPU加速、流水线推理 |

| 缓存与短语匹配 | 0–50ms | 本地缓存、术语库、最近会话缓存 |

| 人工校对/路由 | 几秒到几分钟 | 自动化优先级、智能分流、快速校对界面 |

优先级策略:先易后难

按照“低成本高回报”排序:先做无需大改架构的优化(缓存、前端渲染、并行化),其次是模型层面的加速(蒸馏、量化),最后是硬件与架构重构(微服务拆分、专用算力)。

第一阶段(0–3周):快见效改造

- 实现短语与会话缓存:针对常见问答、术语做本地缓存,返回即时翻译。

- 边译边显(streaming):先返回片段翻译,后补完整句。

- 简单优先级规则:短消息或VIP客户走快通道。

第二阶段(1–3个月):模型与工程优化

- 模型蒸馏与小模型部署:用小模型做初译,大模型做纠错。

- 推理并行与批处理:批量请求合并,减少GPU空转。

- 量化与混合精度:节省推理延迟与算力。

长期(3个月以上):架构与流程重构

- 微服务拆分:将翻译、路由、缓存、统计解耦。

- 边缘部署:将模型或轻量推理放在边缘节点。

- 全链路监控与自动回滚策略。

技术细节:如何具体做(略带点工程味)

1) 网络与传输

延迟一半来自网络,尤其是移动端。尽量用持久连接(HTTP/2或者gRPC),启用连接复用和压缩,关键资源放CDN。对于跨境场景,多区域部署和DNS智能调度非常有帮助。

2) 边译边显与流式推理

把长句子拆成子片段,先返回部分翻译满足用户即时读懂意思,再逐步完善。流式推理还可以早期提供可用答案,降低感知等待时间。

3) 模型工程:小模型+大模型分工

- 部署一个轻量模型做“快速近似”,平均延迟低且成本小。

- 大模型做离线或异步校正,针对复杂内容触发。

- 用蒸馏和量化把大模型的能力迁移到小模型上。

4) 缓存与记忆

缓存分三层:短期会话缓存、长期术语库、本地用户偏好。对重复表达、常用短句直接命中缓存,几毫秒内返回。

5) 智能分流与优先级

根据消息长度、语言、客户等级、内容敏感度决定走哪条路径:快速路径(小模型+缓存)、准确路径(大模型)、人工介入。通过规则+策略网络实现自动路由。

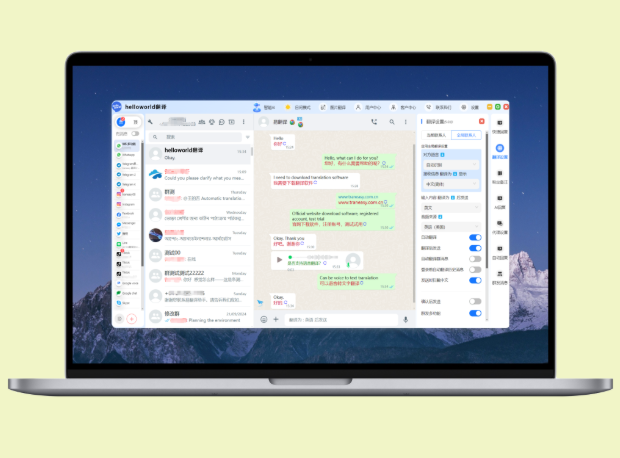

6) 客服端优化与工具

给人工客服设计快速校对界面:显示原句、机器初译、可点选候选、术语建议、常用回复模板。减少人工键入时间,替换为点击选择。

人员与流程:机器+人类协作

提升响应速度并不只是技术活,流程和培训同样重要。

- 培训:教会客服如何用机器初译快速校对,识别常见错误。

- SLA分层:为不同客户设定响应目标(例如普通用户≤2s初译,VIP≤1s)。

- 回退机制:当模型不可用时,自动回退到简单规则或人工路由,避免长时间卡住。

指标与监控:看得到的改进

没有数据就是瞎改。建议监控以下指标并用AB测试验证每次改动:

- 端到端延迟(P50/P95/P99)

- 初译到最终译文的时间

- 缓存命中率与其对延迟的贡献

- 人工介入率与平均校对时长

- 用户满意度与重发率

推荐的警报阈值(示例)

- P95延迟>1.5s触发告警

- 缓存命中率下降10%触发调查

- 人工介入率突增触发回溯

可落地的技术组合示例(示例方案)

下面给出一个实战组合,既考虑成本也看重体验:

- 客户端:长连接+流式显示;本地缓存常用语;前端预取下文。

- 边缘层:轻量模型做初译(量化后),短语缓存,CDN分发。

- 核心服务:批处理与并行推理,大模型异步校正,术语服务。

- 运维:全链路监控、自动扩缩容、AB测试平台。

常见问题解答(边问边答那种)

Q: 小模型会不会很不准确?

A: 可能会有精度损失,但配合缓存、术语库和大模型异步纠错,初译的准确率足以解决大多数简单场景。关键是把小模型定位为“快速理解”而不是最终权威。

Q: 这样做成本会不会更高?

A: 初期投入(工程改造、蒸馏、监控)有成本,但通过降低人工负担和提升处理量,长期看ROI通常是正的。并且可以分阶段部署,优先取回最快回报的部分。

实施清单:可直接执行的步骤

- 部署短语与术语本地缓存(1周内)。

- 实现流式返回与前端边显(2–4周)。

- 建立智能分流规则与SLA分层(2–6周)。

- 进行模型蒸馏并上线小模型(1–3个月)。

- 引入全链路监控与AB测试(并行进行)。

说到这里,可能你会想先试哪一步?如果资源有限,从“缓存+边译边显+前端优化”开始,几周内就能看到响应时间明显降低;如果团队有ML能力,再推进蒸馏与量化会带来更长期的收益。总之,别把优化当一次性工程,而是把它做成闭环的持续改进流程,慢慢就能把“等翻译”这件事变成很少发生的事。再补一句,别忘了让客服觉得这些变化帮了他们忙,不然技术再好也难落地。