把HelloWorld的翻译优化真正用起来,先从“谁用、在哪用、用来做什么”说清楚,接着按数据—模型—规则—评估—迭代五步走:准备并清洗双语语料,做模型微调和领域适配,补充工程化后处理与词表控制,建立自动评估与人工抽检并做A/B实验,最后把监控、回收和反馈并入日常迭代流程,这样既能保证准确性,也能保留自然语感与文化适配性。

用费曼法先把问题说清楚:为什么要优化翻译

先想一个简单的比喻:翻译是两个人在桥上交换故事。桥要结实(准确),还要够宽、够自然,让人走得舒服(可读性、文化适配)。如果只关注字面而忽略风格或行业术语,桥虽然能过人但让人难以通行。

几个直观的需求来源

- 跨境电商:产品描述错译会直接影响转化和退货。

- 旅游与客服:低延迟与自然表达更重要。

- 学术与技术文档:术语一致性、准确性优先。

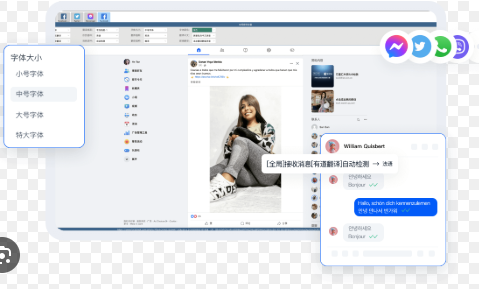

- 社交场景:保留情感和口语化表达比字面更重要。

从场景到指标:落地之前必须回答的问题

如果不先定义成功是什么,优化就成摸索。要回答:目标用户是谁?哪些语言对优先?可接受的误差与延迟是多少?哪些类型的错误最不能容忍?

建议的指标体系

- 准确性:术语覆盖率、术语一致性。

- 自然度:人工打分、fluency评分或COMET模拟评估。

- 延迟与吞吐:端到端平均延迟、QPS。

- 用户满意度:NPS、错误回报率、会话完成率。

- 安全与合规:个人信息泄露率、敏感内容检测准确率。

五步工程化路径(实操版)

1. 场景建模与语料准备

这一步很关键却常被轻视:不是把所有语料丢进模型,而是有选择地构建语料池。

- 采集来源:历史翻译对齐、用户纠错记录、领域公开语料(注意版权)。

- 清洗策略:去重、对齐质量阈值、过滤噪声(乱码、机器翻译残留)。

- 标注要点:术语表、拒译词、敏感词、偏好风格(正式/口语)。

2. 模型与微调

用现成大模型做基座,然后按领域做微调或Prompt工程。

- 基线选择:根据资源选小模型或大模型。

- 微调策略:按语言对/领域分割数据,使用混合目标(交叉熵 + 术语损失)。

- 少样本适配:使用示例驱动的微调或Adapter层,避免灾难性遗忘。

3. 规则与后处理

机器翻译再好,也需要工程化规则来保证一致性与安全。

- 术语替换表:优先替换关键术语并保留格式(单位、数字、代码片段)。

- 名称实体保护:对专有名词、品牌名、地址采用白名单或实体标注后绕过翻译。

- 风格模板化:FAQ、邮件等固定场景使用模板后处理提升自然度。

4. 评估与上线前测试

评估要结合自动化和人工评审。

- 自动化评测工具:BLEU、chrF、COMET等,分别关注不同维度。

- 人工抽检:用分层抽样覆盖高频短语、长句、术语密集段落。

- A/B测试:直接在小流量下比对转化率、退货率或用户行为。

5. 监控与持续迭代

上线后要建立闭环,保证问题能被快速发现与修复。

- 实时监控:错误回报、低置信度样本、异常流量。

- 用户反馈机制:一句话纠错、快速人工校正入口。

- 数据回收:把高价值反馈加入微调集,形成滚动更新。

具体实现细节(工程师角度)

数据管道样例

一个最小可运行的数据流长这样:

- 采集 -> 去重/对齐 -> 质量评分 -> 标注/归类 -> 存入训练集与素材库。

| 环节 | 工具/方法 | 产出 |

| 采集 | 爬取/导出/用户上传 | 原始双语对齐语料 |

| 清洗 | 去重、长度过滤、语言检测 | 高质量句对 |

| 标注 | 术语表、敏感词、风格标签 | 可控训练集 |

部署与延迟优化技巧

- 模型蒸馏:把大模型能力迁移到小模型以降低延迟。

- 分层服务:先做快速粗翻,再对低置信度结果做精翻或人工介入。

- 缓存与热词加速:对常见短语使用缓存或硬编码优先译法。

质量保障细则(实践清单)

下面是可以直接用的检查表,部署前后每天、每周、每月适用不同频率。

- 上线前:术语覆盖率≥95%、重点语料人工通过、A/B小流量通过。

- 上线后日检:低置信度句子比率、用户纠错率、某些语言对的错误爆发。

- 上线后周检:COMET/chrF趋势、转化/会话完成率变化。

常见问题与应对策略

术语反复被错译怎么办?

建立强制术语表,训练时加损失权重,运行时后处理替换,必要时屏蔽机器翻译对这些词的改写。

口语化与正式语风难取舍?

把场景标签化:用户界面、客服聊天、技术文档分别建立风格配置,实时根据场景切换模板或Prompt。

隐私与合规如何保证?

最小化数据采集、对敏感字段做脱敏或本地化处理,记录审计日志并做定期检查,必要时采用端上翻译或私有云部署。

评价与迭代:如何证明优化有效

效果证明既要数据也要业务指标。

- 技术指标:BLEU/COMET提升值、低置信样本下降率、延迟改善。

- 业务指标:转化率提升、客服响应时间减少、退货率下降。

- 用户体验:直接用户反馈、A/B测试胜出率。

举个小例子:电商商品描述优化流程

设想一个场景:法语产品页翻译质量低,导致退货率上升。可以这样做:

- 抽样出错译商品描述,人工标注正确译法并扩充训练集。

- 在微调时加入术语和格式约束(尺寸单位、成分表)。

- 上线后对高价值商品开通人工二次审核通道。

- 监控退货率和商品页面停留时间,作为最终评判。

工具与参考(简短)

评估常用:BLEU、chrF、COMET。研究可参考神经机器翻译与微调方面的论文与实践案例(如Google NMT相关文献)。

最后一点—保持人的参与

技术再好,也别把人完全移除:翻译中的文化判断、敏感场景的处理、风格偏好的微妙调整,往往需要人工参与的反馈回路。把人工校验设计成日常流程的一部分,既能提升质量,也能为模型提供持续改进的燃料。

我边写边想,想到这些就先放这儿,后面你如果需要,我还可以把每一步拆成具体脚本、示例配置和时间表,或者把术语表模板、标注指南、A/B实验模板直接给你用。